A teoria da comunicação está do lado de Boneco

“Mas isso é óbvio, Tadeu! Pô, Tadeu! Eu perdi dez contos”

Boneco, participante do BBB 26, não se aguentou. Na dinâmica que envolvia a escolha entre receber R$10 mil ou uma “informação privilegiada”, Boneco optou pela última.

Tadeu Schmidt, o apresentador, então concedeu:

“Hoje vamos conhecer o último líder do BBB 26.”

Já era a penúltima semana do jogo. Portanto, era a última ocorrência de muitas das dinâmicas semanais, como a prova do líder. Boneco, dentro do reality, sabia disso melhor do que ninguém.

Não por outro motivo, achou que fosse brincadeira. “A informação não é essa não.” – disse o participante. O apresentador reiterou: “É essa. Eu juro que é essa!”

Essa cena, tão banal, não saiu da minha cabeça. Lá dentro, martelou e martelou – até nascer esse texto.

Há nela uma riqueza escondida e fascinante. Precisava ser revelada – as riquezas escondidas no banal são sempre as maiores, como já sabem há muito os cronistas, os jornalistas, os sociólogos, os antropólogos etc.

Que Boneco tem razão na sua revolta, isso é óbvio. E por ser óbvio, esse texto não é sobre isso.

Parto do óbvio para destrinchar as próprias razões que fazem do óbvio óbvio. Razões essas que, talvez, não sejam assim tão óbvias.

Boneco tem razão na sua revolta por quê?

Na resposta simples: o comunicado foi ruim. Claramente não valia o dinheiro. E isso todos já sabemos. O tribunal da internet já concordou.

Mas não quis parar nessa análise de “foi ruim”. Ainda é simples demais. Diria Antonio Cicero que “enquanto simplificar um pensamento é empobrecê-lo, complicar um pensamento é torná-lo ou revelá-lo como mais complexo, mais diferenciado, mais rico do que parecia ser.”

Para revelar a riqueza dessa cena, do banal, preciso complicá-la.

Acredito que a razão da revolta de Boneco não seja apenas que a comunicação tenha sido ruim. Mas sim que, intuitivamente, a revolta advenha do fato de que o que foi dado pela produção não era informação.

A tal dinâmica impunha uma escolha entre R$10 mil e uma informação privilegiada. Valha ou não valha R$10 mil, pressupõe-se, ao menos, que haverá uma informação. Mas não houve!

E por que não?

Há livros que mudam nossa forma de pensar. Para mim, um desses foi “Incerteza, um ensaio”, de Eugênio Bucci. Foi a partir dele que tive contatos com outras formas de pensar “informação” enquanto conceito. E de forma didática. Por isso, baseio-me nele para fazer, aqui, este pequeno ensaio sobre incerteza e informação aplicado ao caso de Boneco.

Foi em 1948 que A Mathematical Theory of Communication (Uma Teoria Matemática da Comunicação, em tradução livre), de Claude Shannon, foi publicado. Não tardou para, como diz Eugênio Bucci, virar “bibliografia definitiva”.

Nesse artigo inovador, Shannon traduziu a “informação”, conceito abstrato que é, em uma grandeza matemática mensurável. Tornou-a palpável. E mudou tudo.

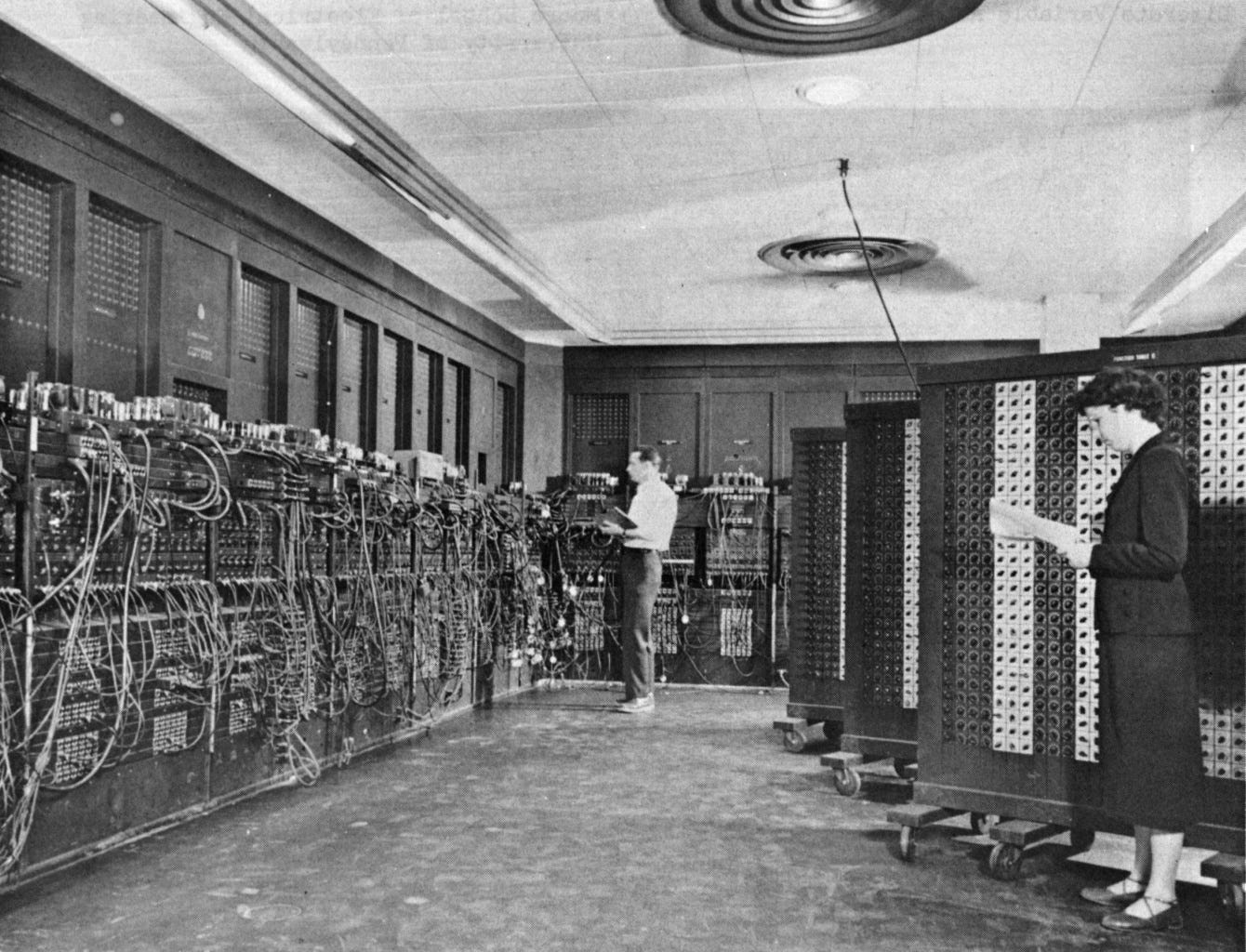

Shannon fez parte de uma geração de cientistas que precisavam resolver problemas práticos na comunicação entre computadores – num tempo em que os bits ainda eram interruptores enormes. Em que computadores ocupavam salas inteiras.

As mensagens eram sinais elétricos. Enviadas fisicamente entre as máquinas por linhas de transmissão. Havia falhas, interferências, deterioração da rede, variações de tensão. Como garantir que a mensagem recebida por um computador era a mesma que foi enviada por outro? Como separar a informação do ruído? E como aumentar a eficiência da comunicação? – isto é, aumentar a quantidade de dados enviados na menor quantidade de sinais elétricos.

Enfrentando esses problemas, revolucionaram a computação. No pensar teórico, partiram de uma metáfora importada da física, da termodinâmica, para aplicar à comunicação entre máquinas: a entropia.

A entropia se referiria ao grau de imprevisibilidade dentro de um sistema – ou seja, à incerteza quanto aos possíveis outputs que poderiam vir desse sistema. Quanto mais previsível for, menor será a entropia do sistema. Quanto mais imprevisível, o inverso: maior entropia – mais “caótico”

Podemos exemplificar: um jogo de cara ou coroa poderia ser tomado como um sistema de baixa entropia. Só há dois possíveis outputs, dois resultados. Cada um com 50% de chance de ocorrer.

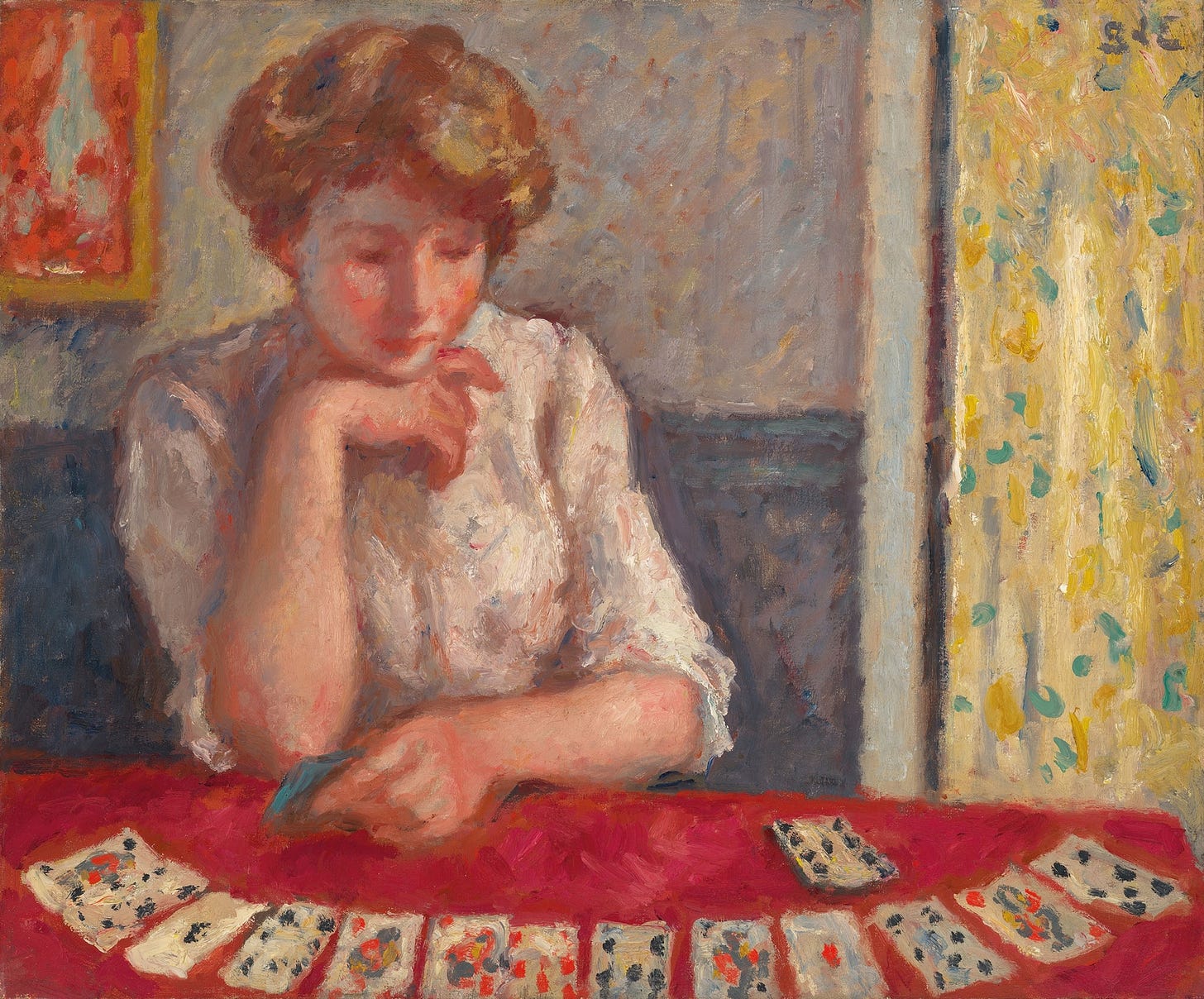

Já um jogo de pôquer, jogado com baralho de 52 cartas com enésimas combinações probabilísticas, pode ser considerado um sistema de alta entropia.

No pôquer, qual a chance de recebermos uma “boa mão”?

Para respondermos a essa pergunta, é preciso levar em consideração todas as mãos possíveis. Todas as combinações possíveis. E saber, dentre as mãos, quais têm as maiores chances de vitória sobre as outras tiragens. Não é algo trivial, mas é possível.

Mas quase nada adianta saber essas possibilidades. Só saber. Na hora do jogo, é virtualmente impossível prever quais cartas teremos na mão (e também os outros jogadores) e quais cartas estarão na mesa. Assim, há uma grande incerteza. É um jogo, inclusive, que só pode acontecer com incerteza. Em virtude da incerteza. Para poderem acontecer as apostas, os blefes, o mis-en-scène todo.

Se algum dos jogadores souber de fato as cartas nas mãos dos demais ou as cartas na mesa, acaba-se o jogo. É desonesto.

Ao mesmo tempo, é o desejo de cada jogador de pôquer saber (ou ter um bom palpite) sobre as cartas dos demais e da mesa. É claro: a partir disso, ele se coloca em uma posição de vantagem. Por quê?

Ele reduz a sua incerteza. Se alguém “soprar” no seu ouvido as cartas dos demais, informará o jogador. Essa informação muito possivelmente determinará sua jogada. Em um jogo com tantas probabilidades, com alta entropia, essa informação tem grande valor.

Norbert Wiener, outro cientista norte-americano, foi um que “advogou como poucos a junção entre os conceitos de entropia e de informação”, como coloca Eugênio Bucci. Para o cientista, a informação era o negativo de sua entropia.

Em outras palavras, informação é aquilo que resolve a entropia. Que “leva a uma possibilidade de organização onde antes imperava desorganização”, nas palavras de Bucci.

Mas mais do que apenas conceitos abstratos, também podem ser grandezas. Informação é entropia com sinal negativo.

Sendo grandezas, podem ser medidas. Podem ser calculadas, exprimidas em equações. Têm tamanhos, têm valores.

Se entropia é imprevisibilidade, informação é previsibilidade. Diante de um sistema com alta entropia – isto é, com muita imprevisibilidade –, temos uma grande incerteza quanto ao output. Num sistema de baixa entropia, o contrário: previsibilidade, porque temos alguma certeza – por mais que não seja integral.

Voltando ao cara ou coroa. Só há duas opções bem marcadas: cara ou coroa. Podemos até pensar na probabilidade ínfima de a moeda cair na borda e ficar “em pé” na vertical (nem cara, nem coroa), mas o sistema não comporta esse output – é erro ou ruído. Não vale.

Bom, vamos supor que tenhamos convidado o vidente A para assistir a uma “partida” de cara ou coroa com 10 rodadas. E que, no evento, ele venha a acertar todos os resultados.

É impressionante, claro. Considerando a chance de 50% de cara ou de coroa, a probabilidade de que alguém acerte 10 vezes em sequência o palpite no jogo é de 0,097%. Quase uma em mil.

O vidente B (um outro) é convidado para ver alguém tirar dez cartas de um baralho. Ele deverá dizer quais vão sair e em que ordem. Tiradas as cartas, ele acerta todas.

Nesse caso, a possibilidade de ele dar o exato resultado era de uma em 57,6 trilhões. É muito, muito mais impressionante!

Independente dos poderes de clarividência de cada um, é objetivamente mais difícil acertar no segundo caso. Todas as incertezas são maiores. Tanto a incerteza da carta que sairá quanto da sequência.

O vidente B tem uma informação de maior valor do que o vidente A. Isso porque a informação que o vidente B possui é consideravelmente mais difícil de se obter do que a do vidente A. Ou seja, ela “organiza” um sistema muito mais caótico. Ou seja, ela resolve uma incerteza também muito maior em tamanho.

Com isso, chegamos à conclusão desses cientistas das décadas de 1940 e 1950 que logo perceberam que o valor de uma informação estava diretamente relacionado à incerteza que ela pretende resolver (ou reduzir).

Para a computação, foi essencial. Naquele mar de impulsos elétricos, havia muito ruído. Mas entender a entropia e a informação como grandezas permitiu calculá-las e, assim, criar melhores códigos para compensar o ruído e garantir maior integridade da informação transmitida entre máquinas.

Abstraio para tornar mais concreto.

Todas essas questões são apreensíveis no cotidiano. Quando buscamos, por exemplo, conselho para alguém experiente em um assunto em que não dominamos ou uma consultoria – queremos reduzir a incerteza e confiamos que, pelo conhecimento da pessoa, ela terá informações de valor; Quando olhamos a meteorologia, a previsão – reduz a incerteza sobre o tempo, a informação permite que façamos melhor escolha das roupas que vamos usar (e ficamos frustrados quando não resolve a incerteza, isto é, quando erram a previsão).

Vivemos em um mundo de incertezas. Queremos saná-las. Daí a buscarmos tantas informações. Somos ávidos por informações.

Até mesmo em questões muito abstratas e existenciais – como o que ocorre após a morte, se há vida em outros planetas, se Deus existe e tanto mais. Coisas que não têm resposta. Se houvesse alguma informação quanto a elas, seria de valor inestimável em razão do tamanho imensurável da dúvida que resolveriam.

Em suma: informação só existe quando há incerteza. Informação resolve incerteza.

Por isso, se já sabemos que o sol nascerá amanhã (porque nasce todo dia), alguém que vire e diga “o sol nascerá amanhã” não trará informação nenhuma. Não existe a incerteza. É uma informação com valor zero – ou seja, é redundância. A probabilidade de ocorrência é de 100%.

E, ainda, se alguém disser, por exemplo, que não vamos nos tornar jacarés tomando vacina, também não é informação. Porque a probabilidade de não ocorrência é de 100%. Mas é importante dizer para combater a desinformação – que pode ser lida, ao revés, como o erro ou ruído que gera mais incerteza em vez de resolvê-la, mas que finge resolvê-la, finge ser informação.

Nelson Rodrigues diz (e eu concordo) que o óbvio deve ser dito. Deve. Mas o óbvio não é informação. É qualquer outra coisa: afirmação, constatação, atestação…

E, com toda essa volta, voltamos ao simples caso do Boneco.

Na dinâmica “informação privilegiada”, o que o dado da produção agregou? Qual a incerteza que reduz para o jogador? Qual privilégio o concede?

Ao fazer uma constatação óbvia – autoevidente, apreensível para o próprio jogador –, o dado tinha valor zero de informação. Era apenas redundância. A contar pela própria agenda do programa, a probabilidade era de 100% de que, naquele dia, seria determinado o último líder.

O BBB pode ser lido, na visão dos jogadores, como um sistema de alta entropia. Eles não sabem como as ações deles repercutem aqui fora. Não sabem o que pensa a opinião pública, os percentuais das votações. São rodeados por incertezas.

Por isso, uma informação – por menor que seja – pode ter grande valor. E por esse mesmo motivo a produção sabe que deve esconder as informações o quanto possível. Com informação, pode-se fazer estratégia.

Na tal dinâmica, o interessante é que o privilégio da informação passa a ter um valor financeiro concreto. Ou seja, R$10 mil reais – o montante que o participante deve abrir mão para obtê-la. Mas esse é um custo e não é o valor da informação.

Custo e valor não são o mesmo.

Tanto é que Boneco não foi o primeiro a sair frustrado. Outros também já tinham saído descontentes com os dados que vinham recebendo da produção. Ou seja, o valor da informação dada já não vinha correspondendo ao seu custo.

Vale pagar R$10 mil para alguém dizer que o sol nascerá amanhã?

Sem poder fazer o cálculo do custo versos o valor da informação que receberá, o jogador deve fazer uma aposta. Faz parte. Tudo bem. Mas é preciso se ater às regras, às premissas que regem o jogo, a dinâmica.

Ou seja: é preciso, no mínimo, que haja informação. A probabilidade de que ele receba alguma informação deve ser maior que zero. Não precisa ser útil – até porque a utilidade depende muito da estratégia do jogador – mas precisa ser informação. Precisa reduzir alguma incerteza.

No caso de Boneco, já é claro, não foi informação. A produção pediu que ele apostasse em um cara ou coroa. Ele fez.

Mas a moeda caiu em pé. Nem cara, nem coroa: erro – que lhe custou dez contos.

*

Rio de Janeiro, 17 de abril de 2026.

Agradecimentos

Agradeço a Beatriz Bezerra, jornalista e especialista em comunicação, pela análise e pelas opiniões sobre esse ensaio, que me encorajaram à publicação.

Deixe um comentário